Met de opkomst van GenAI-tools zoals ChatGPT lijkt machinevertaling nu ook het veld van literair vertalen te betreden. Maar moeten we deze tools wel zien als vertaalmachines? Dit artikel kiest voor een ander perspectief: GenAI niet als automatische vertaler, maar als denkpartner bij het brainstormen, als klankbord voor je twijfels, of als sparringpartner bij complexe vertaalkeuzes. Het concept van Human-Centered Augmented Translation laat zien hoe literaire vertalers AI bewust kunnen inzetten als cognitief hulpmiddel.

Literair vertalen en machinevertaling

Literair vertalen werd tot voor kort beschouwd als “the last bastion of human translation” (Toral en Way 174). CAT-tools en automatische vertaling waren vooral bedoeld voor technische of commerciële teksten, waardoor ze nauwelijks ingang vonden in het literaire domein. Die terughoudendheid heeft te maken met een fundamentele mismatch tussen de logica van vertaaltechnologie en de aard van literair vertalen, waarin esthetiek, emotie, culturele nuance en creatieve interpretatie centraal staan.

Met de komst van neurale vertaalsystemen (Neural Machine Translation, NMT) begon de automatische vertaling echter ook langzaam terrein te winnen binnen het literaire domein. Anders dan eerdere statistische systemen leren neurale modellen zelf taalpatronen herkennen via deep learning, waardoor ze natuurlijker klinkende vertalingen produceren. Deze vooruitgang leidde tot experimenten met literaire vertalingen en onderzoek naar de bruikbaarheid van zulke tools, wat gemengde resultaten opleverde.

Die ontwikkeling versnelde verder met de opkomst van generatieve AI-tools (GenAI-tools) zoals ChatGPT, Gemini, Perplexity en Claude, die gebaseerd zijn op grote taalmodellen (Large Language Models, LLM's). Zulke systemen kunnen niet alleen vertalen, maar ook stijlen imiteren, motieven herkennen en zelfs literaire fragmenten genereren. Deze indrukwekkende capaciteiten doen de vraag rijzen: is het literaire domein nog wel het "laatste bastion" van menselijk vertalen?

Empirisch onderzoek schetst een genuanceerder beeld. Aan de ene kant tonen evaluaties aan dat menselijke literaire vertalingen nog steeds beter presteren dan onbewerkte LLM-vertalingen: zelfs de meest recente modellen produceren vaak meer letterlijke en minder gevarieerde vertalingen dan menselijke vertalers (Macken et al. 6-7; Zhang et al. 10969). Aan de andere kant blijkt dat wanneer professionele vertalers LLM-vertalingen bewerken (post-editing), het niveau van creativiteit vergelijkbaar is met menselijke vertalingen from scratch (Castaldo et al.).

Voor vertalers blijft het vertrouwen in GenAI als automatische vertaler laag, vooral wat betreft nauwkeurigheid, betrouwbaarheid en transparantie (Rivas Ginel en Moorkens, “Translators’ Trust” 290).Maar opvallend genoeg toont eerder onderzoek van dezelfde auteurs aan dat vertalers wel manieren vinden om GenAI te gebruiken als hulpmiddel en vooral als inspiratiebron (Rivas Ginel en Moorkens, “A Year of ChatGPT” 269). Dat wijst op de noodzaak van een ander perspectief: niet gericht op automatisering, maar op versterking van menselijke creativiteit. Het kader van Human-Centered Augmented Translation biedt precies dat alternatief.

Human-Centered Augmented Translation (HCAT)

Het idee van Human-Centered Augmented Translation (HCAT) gaat uit van technologie die menselijke vermogens versterkt in plaats van vervangt. Volgens Sharon O'Brien (395-396) is het vertaalproces al decennialang 'geaugmenteerd' door hulpmiddelen zoals vertaalgeheugens en terminologielijsten. Zulke tools nemen routinetaken over, zodat vertalers hun aandacht kunnen richten op creatieve en interpretatieve aspecten.

Tot nu toe was die augmentatie echter vooral gericht op efficiëntie en productiviteit, doelen die de commerciële vertaalmarkt ten goede komen (O'Brien 400). Voor literaire vertalers ligt dat anders: hun werk vraagt niet om snelheid, maar om diepgang, stijlgevoel en culturele interpretatie (Hadley 92). Dit roept een centrale vraag op: hoe zou augmentatie eruitzien wanneer we vertrekken vanuit de behoeften van literaire vertalers?

O’Brien stelt dat mensgerichte augmentatie verschillende vormen kan aannemen. Denk aan hulpmiddelen die cruciale passages visueel markeren, of systemen die het werktempo tijdelijk vertragen wanneer cognitieve belasting te hoog wordt (401). Een concreet voorbeeld is PunCAT, een tool die vertalers ondersteunt bij het vertalen van woordgrappen. Empirisch onderzoek toont aan dat dit systeem het scala aan creatieve oplossingen vergroot en zo de probleemoplossing versterkt bij linguïstisch complexe passages (Kolb en Miller 67). In zo'n benadering staat de vertaler centraal, niet de machine.

Hoewel generatieve AI-tools zoals ChatGPT op het eerste gezicht voornamelijk ontworpen lijken voor efficiënt tekstgebruik, kunnen ze binnen een HCAT-kader ook een rol spelen als mensgerichte ondersteuning. Daarvoor moeten we wel begrijpen hoe deze systemen werken en wat hun mogelijkheden en grenzen zijn.

GenAI in een HCAT-kader: hoe ze ons denken kunnen versterken

ChatGPT, Claude en Gemini zijn applicaties die draaien op grote taalmodellen (Large Language Models, LLM’s). Deze modellen zijn AI-systemen die getraind zijn op enorme hoeveelheden tekst om taal te begrijpen én nieuwe content te genereren, vandaar de term generatieve AI. Via de chatbot-interface kun je met zo’n model in gesprek: je geeft instructies, stelt vragen, krijgt feedback en bouwt voort op eerdere input.

In tegenstelling tot traditionele machinevertaaltools is de interactie dynamischer. Vertalers kunnen om verduidelijking vragen, context toevoegen, argumentaties toetsen of alternatieven verkennen. Deze dialogische aard opent mogelijkheden die verder gaan dan automatische vertaling alleen. Chatbots kunnen namelijk ook worden ingezet voor tekstanalyse, het verkennen van stijlvarianten of het genereren van ideeën die het vertaalproces kunnen ondersteunen.

1. GenAI als ‘reasoning tool’

Chatbots kunnen helpen om een tekst beter te begrijpen. Ze kunnen structuren blootleggen, informatie samenvatten, toon analyseren en redeneringen reconstrueren. Daardoor kunnen ze gebruikt worden om intertekstuele verwijzingen op te sporen, taalpatronen te herkennen, culturele elementen te duiden, spreekstijlen van personages te analyseren en verborgen nuances zichtbaar te maken. Op die manier ondersteunen ze het interpretatieve deel van het vertaalproces. [1]

Deze functie is bijzonder nuttig voor beginnende vertalers die hun analytische vaardigheden nog aan het ontwikkelen zijn, maar ook ervaren vertalers kunnen chatbots inzetten als sparringpartner bij complexe of onbekende passages. Cruciaal blijft wel dat hun output kritisch wordt beoordeeld en steeds wordt getoetst aan betrouwbare bronnen.

2. GenAI als ‘brainstorming tool’

Chatbots kunnen ook ideeën genereren: synoniemen, stilistische varianten, rijmwoorden of nieuwe invalshoeken. Door voor een vertaalprobleem meerdere alternatieven aan te reiken, stimuleren ze divergent denken en kunnen ze de voorbereidings- en incubatiefase van het creatieve proces ondersteunen (zie Guerberof Arenas en Van Egdom).

De vertaler krijgt zo een reeks denksporen aangereikt die niet dienen als eindoplossing, maar als inspiratiebron om verder te bewerken. De uiteindelijke vertaalkeuze blijft daardoor een bewuste creatieve beslissing van de vertaler, en niet van het model.

3. GenAI als ‘writing tool’

Ten slotte kunnen chatbots tekst produceren op basis van instructies: parafraseren, samenvatten of een eerste vertaalvoorstel genereren. Voor vertalers is dit vooral nuttig om alternatieven te verkennen. Door eerst zelf een passage te vertalen en vervolgens de chatbot om varianten in verschillende tonen of registers te vragen, wordt zichtbaar hoe dezelfde betekenis in uiteenlopende vormen kan worden gegoten. Denk aan formeel, informeel, humoristisch, of in de taal van jongeren. Dit is vooral waardevol omdat zelfs ervaren vertalers niet alle registers van hun doeltaal even goed beheersen. De chatbot helpt zo bij het weloverwogen kiezen van de formulering die het beste past bij de brontekst en doelgroep.

Deze toepassingen laten zien dat chatbots meer zijn dan vertaaltools. De sleutel tot effectief gebruik ligt in het beheersen van prompting technieken.

Wat is prompting?

Als je met een chatbot werkt, bepaalt de kwaliteit van je instructies grotendeels de bruikbaarheid van de output. Dit sturen van AI heet prompting: het formuleren van opdrachten, vragen of instructies die de chatbot duidelijk maken wat je precies wilt.

Enkele technieken voor prompting: van simpel naar complex

Om chatbots effectief in te zetten voor deze toepassingen, kun je gebruikmaken van verschillende prompting technieken. Hieronder volgen drie veelgebruikte technieken, geordend van simpel naar complex: [2]

1. Zero-shot prompting: de directe vraag

In deze vorm krijgt het model geen voorbeelden of demonstraties (zero shots) en moet het de opdracht dus volledig op basis van de instructie uitvoeren. Het is een bijzonder flexibele manier van prompting, die kan variëren van een eenvoudige vraag (“Wat betekent deze uitdrukking?") tot een gedetailleerde opdracht ("Analyseer de mythologische motieven in deze tekst: identificeer de motieven, leg hun traditionele betekenis uit, en bespreek hun functie in de tekst").

Het voordeel van deze techniek is de eenvoud: geen voorkennis nodig, geen voorbereidende voorbeelden, en gemakkelijk aan te passen als het resultaat niet bevalt. Begin bij voorkeur met een eenvoudige prompt en maak deze complexer als dat nodig blijkt. Onderzoek toont aan dat minimale instructies vaak verrassend goede resultaten geven en dat te complexe instructies de AI juist kunnen verwarren (Du et al. 587). De kunst is om de juiste balans te vinden tussen genoeg context en te veel details.

2. One- en Few-shot prompting: leren door voorbeelden

Bij deze techniek geef je één (one-shot) of meer (few-shot) voorbeelden mee van jouw eigen denkproces of eerdere keuzes, waarna de AI het patroon kan volgen.

Voorbeeld:

"Analyseer de volgende cultuurspecifieke elementen en geef suggesties voor hoe ze vertaald kunnen worden naar het Engels.

Hier is een voorbeeld van wat ik bedoel:

Term: "Oliebol"

Analyse:

- Cultureel gebied: Eten

- Probleem: geen equivalent in doeltaalcultuur

- Mogelijke oplossingen:

- Uitleg toevoegen (bv. ‘Dutch doughnuts’)

- Equivalent zoeken (bv. 'doughnut')

- Leenwoord behouden + voetnoot (bv. ‘oliebol* Dutcht doughnuts traditionally eaten on New Year’s Eve’)

Nu zijn dit de termen die ik wil analyseren: [LIJST MET TERMEN]"

Door concrete voorbeelden van het gewenste analyseformat te geven, leert de chatbot welk type antwoord verwacht wordt. Onderzoek bevestigt dat deze aanpak effectief is: het verstrekken van enkele domeinspecifieke voorbeelden verbetert de prestaties aanzienlijk, hoewel te veel voorbeelden de AI kunnen overweldigen (Gao et al.).

3. Chain of Thought prompting: vragen om redenering

Bij deze techniek wordt de AI gevraagd om expliciet stap voor stap te redeneren en dit redeneerproces te laten zien. Dit maakt het denkproces transparant en helpt de vertaler om de eigen gedachten te ordenen.

Voorbeeld:

"Vergelijk de taal van personage A en personage B.

Denk hardop en werk in stappen:

- Hoe spreekt elk personage?

- Wat zegt dit over hun achtergrond, emoties of machtspositie?

- Welke vertaalproblemen ontstaan daardoor?

- Welke strategie past bij elk personage?

- Hoe kan het verschil tussen A en B behouden blijven in de vertaling?

Tekst: [PLAATS DIALOOG HIER]"

Deze techniek is vooral nuttig voor het brainstormen over complexe keuzes waar meerdere overwegingen een rol spelen. Ook kunnen zinnen zoals "denk dieper na" of "redeneer stap voor stap" worden toegevoegd om de AI aan te moedigen tot grondigere analyse.

Beperkingen en verantwoordelijkheden

Chatbots hebben belangrijke beperkingen waar literair vertalers rekening mee moeten houden. Ten eerste kunnen ze overtuigend klinken, maar toch onjuist zijn. Omdat ze niet begrijpen wat ze zeggen maar enkel statistische patronen volgen, verzinnen ze soms informatie en geven ze zelden toe dat ze iets niet weten (Moorkens et al. 189). Gebruik chatbots daarom nooit als betrouwbare bron voor feitelijke informatie en verifieer altijd betekenissen, realia en achtergrondinformatie via andere bronnen.

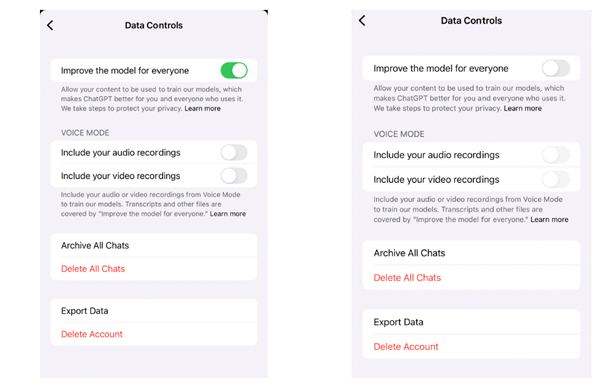

Ten tweede zijn er risico’s rond auteursrecht en privacy. Literaire vertalingen bevatten beschermd materiaal van auteurs en uitgevers. Wanneer volledige passages in een chatbot worden ingevoerd, kan dit leiden tot schending van auteursrechten of ongewenste modeltraining. Ook kunnen AI-aanbieders toegang hebben tot gevoelig vertaalmateriaal. Dit risico kan deels worden beperkt via privacy-instellingen (zie Figuur 1), maar de veiligste aanpak is om geen volledige beschermde passages te uploaden.